Resumo

- Entre as grandes plataformas, o TikTok é a única onde conteúdos pró-Palestina superam consistentemente os pró-Israel em número e visualizações.

- Na outra ponta, a Meta (Facebook e Instagram) tem uma taxa de cumprimento de 94% em solicitações de Israel para remoção de conteúdos, muitas vezes relacionados a publicações pró-Palestina.

- Embora a empresa afirme seguir leis locais e padrões internos, especialistas criticam a falta de transparência nos critérios, apontando para um enviesamento que privilegia um lado do conflito e restringe o contraditório.

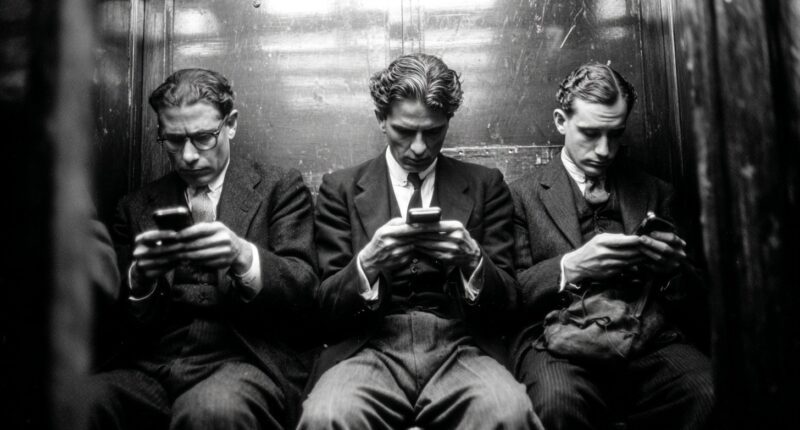

No conflito Israel-Palestina, a disputa pela narrativa não se limita a repórteres, diplomatas e ativistas. As redes sociais — e, mais especificamente, os seus algoritmos — desempenham um papel central ao definir o que milhões de pessoas veem. Meta, TikTok e X adotam estratégias distintas na moderação e promoção de conteúdos, moldando perceções globais de forma invisível mas decisiva.

Relatórios de organizações de direitos digitais e estudos académicos indicam que nenhuma dessas plataformas é neutra. Cada uma aplica filtros, prioridades e restrições que alteram a visibilidade das mensagens, influenciada por pressões estatais, interesses comerciais e modelos de negócio próprios.

TikTok: a exceção pró-Palestina

Entre as grandes plataformas, o TikTok é a única onde conteúdos pró-Palestina superam consistentemente os pró-Israel em número e visualizações. O seu algoritmo, centrado em interações iniciais, permite que vídeos amadores atinjam milhões de pessoas sem depender de grandes seguidores.

Investigadores apontam que a relativa ausência de moderação política direta contribui para essa diferença. Porém, criadores alertam para um aumento de remoções e bloqueios temporários, sinalizando que a plataforma também enfrenta pressões crescentes.

Meta: moderação alinhada a pedidos governamentais

Na outra ponta, a Meta (Facebook e Instagram) tem uma taxa de cumprimento de 94% em solicitações de Israel para remoção de conteúdos, muitas vezes relacionados a publicações pró-Palestina.

Embora a empresa afirme seguir leis locais e padrões internos, especialistas criticam a falta de transparência nos critérios, apontando para um enviesamento que privilegia um lado do conflito e restringe o contraditório.

X/Twitter: desinformação premiada pelo algoritmo

Desde a aquisição por Elon Musk, o X tornou-se fértil para a disseminação de conteúdos enganosos. A mudança no modelo de verificação — agora acessível mediante pagamento — fez com que contas com selo azul e histórico de desinformação tivessem maior alcance.

O sistema comunitário de verificação (Community Notes) revelou-se lento e ineficaz: falhou em corrigir 80% dos conteúdos falsos mais virais no contexto do conflito. Até à intervenção, esses posts já tinham alcançado centenas de milhões de visualizações.

O peso invisível do código

Segundo Sarah Roberts, especialista em políticas digitais, “os algoritmos não são neutros: transportam valores, interesses e prioridades. Ler um feed hoje é também ler escolhas políticas codificadas.”

A guerra de narrativas acontece, assim, em duas frentes: no terreno e nas linhas de código que decidem quais imagens, textos e vídeos merecem lugar no ecrã de cada utilizador.